Mysql事务隔离级别和锁

Mysql事务隔离级别和锁

# 概述

数据库一般都会并发执行多个事务,多个事务可能会并发的对相同的一批数据进行增删改查操作,可能就会导致我们说的脏写、脏读、不可重复读、幻读这些问题。

这些问题的本质都是数据库的多事务并发问题,为了解决多事务并发问题,数据库设计了事务隔离机制、锁机制、MVCC多版本并发控制隔离机制,用一整套机制来解决多事务并发问题。

# 事务及其ACID属性

事务是由一组SQL语句组成的逻辑处理单元,事务具有以下4个属性,通常简称为事务的ACID属性。

- 原子性(Atomicity) :事务是一个原子操作单元,其对数据的修改,要么全都执行,要么全都不执行。

- 由 Undo Log 保证“要么全成、要么全撤”。

- 一致性(Consistent) :在事务开始和完成时,数据都必须保持一致状态。这意味着所有相关的数据规则都必须应用于事务的修改,以保持数据的完整性。

- 由约束/业务规则定义,借助原子+隔离在并发/异常下仍保持有效状态。

- 隔离性(Isolation) :数据库系统提供一定的隔离机制,保证事务在不受外部并发操作影响的“独立”环境执行。这意味着事务处理过程中的中间状态对外部是不可见的,反之亦然。

- 由 MVCC + 锁(记录/间隙/Next-Key) 共同实现;读走快照,冲突靠加锁。

- 持久性(Durable) :事务完成之后,它对于数据的修改是永久性的,即使出现系统故障也能够保持。

- 由 Redo Log(WAL)落盘与崩溃恢复保证;Doublewrite/校验和防半写;Binlog 用于复制与恢复一致性。

# 并发事务处理带来的问题

# 更新丢失(Lost Update)或脏写

当两个或多个事务选择同一行,然后基于最初选定的值更新该行时,由于每个事务都不知道其他事务的存在,就会发生丢失更新问题–最后的更新覆盖了由其他事务所做的更新。

# 脏读(Dirty Reads)

一个事务A正在对一条记录做修改,在这个事务A完成并提交前,这条记录的数据就处于不一致的状态;这时,另一个事务B也来读取同一条记录,如果不加控制,第二个事务B读取了这些“脏”数据,并据此作进一步的处理,就会产生未提交的数据依赖关系。这种现象被形象的叫做“脏读”。

小结:事务A读取到了事务B已经修改但尚未提交的数据,还在这个数据基础上做了操作。此时,如果B事务回滚,A读取的数据无效,不符合一致性要求。

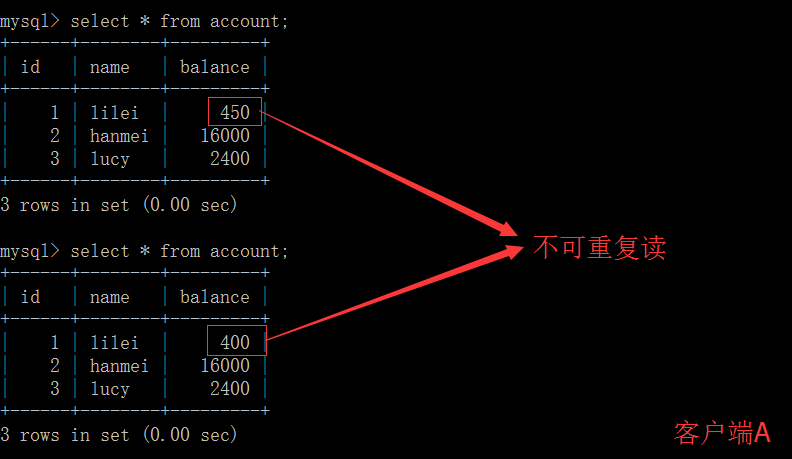

# 不可重复读(Non-Repeatable Reads)

一个事务在读取某些数据后的某个时间,再次读取以前读过的数据,却发现其读出的数据已经发生了改变、或某些记录已经被删除了!这种现象就叫做“不可重复读”。

# 幻读(Phantom Reads)

一个事务按相同的查询条件重新读取以前检索过的数据,却发现其他事务插入了满足其查询条件的新数据,这种现象就称为“幻读”。

小结:事务A读取到了事务B提交的新增数据,不符合隔离性

# 事务隔离级别

“脏读”、“不可重复读”和“幻读”,其实都是数据库读一致性问题,必须由数据库提供一定的事务隔离机制来解决。

| 隔离级别 | 脏读(Dirty Reads) | 不可重复读(Non-Repeatable Reads) | 幻读(Phantom Reads) |

|---|---|---|---|

| 读未提交(Read uncommitted) | 可能 | 可能 | 可能 |

| 读已提交(Read Committed) | 不可能 | 可能 | 可能 |

| 可重复读(Repeatable read) | 不可能 | 不可能 | 可能 |

| 可串行化(Serializable) | 不可能 | 不可能 | 不可能 |

数据库的事务隔离越严格,并发副作用越小,但付出的代价也就越大,因为事务隔离实质上就是使事务在一定程度上“串行化”进行,这显然与“并发”是矛盾的。

同时,不同的应用对读一致性和事务隔离程度的要求也是不同的,比如许多应用对“不可重复读"和“幻读”并不敏感,可能更关心数据并发访问的能力。

查看当前数据库的事务隔离级别: show variables like 'tx_isolation';

设置事务隔离级别: set tx_isolation='REPEATABLE-READ';

Mysql默认的事务隔离级别是 可重复读(Repeatable read),用Spring开发程序时,如果不设置隔离级别默认用Mysql设置的隔离级别,如果Spring设置了就用已经设置的隔离级别

# 大事务的影响

- 并发情况下,数据库连接池容易被撑爆

- 锁定太多的数据,造成大量的阻塞和锁超时

- 执行时间长,容易造成主从延迟

- 回滚所需要的时间比较长

- undo log膨胀

- 容易导致死锁

# 事务优化实践原则

- 将查询等数据准备操作放到事务外

- 事务中避免远程调用,远程调用要设置超时,防止事务等待时间太久

- 事务中避免一次性处理太多数据,可以拆分成多个事务分次处理

- 更新等涉及加锁的操作尽可能放在事务靠后的位置

- 能异步处理的尽量异步处理

- 应用侧(业务代码)保证数据一致性,非事务执行

# 事务隔离级别案例分析

CREATE TABLE `account` (

`id` int(11) NOT NULL AUTO_INCREMENT,

`name` varchar(255) DEFAULT NULL,

`balance` int(11) DEFAULT NULL,

PRIMARY KEY (`id`)

) ENGINE=InnoDB DEFAULT CHARSET=utf8;

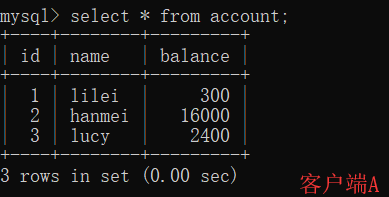

INSERT INTO `test`.`account` (`name`, `balance`) VALUES ('lilei', '450');

INSERT INTO `test`.`account` (`name`, `balance`) VALUES ('hanmei', '16000');

INSERT INTO `test`.`account` (`name`, `balance`) VALUES ('lucy', '2400');

2

3

4

5

6

7

8

9

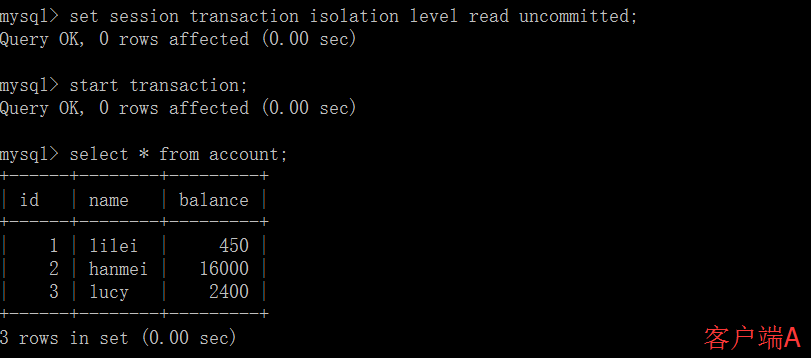

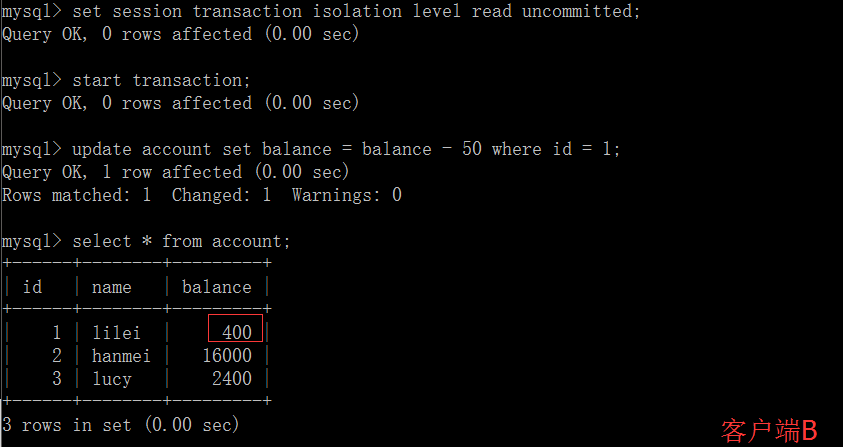

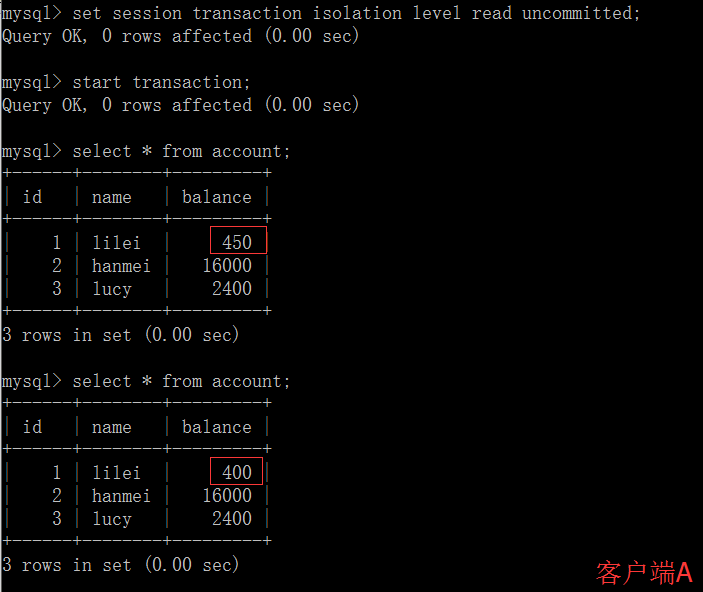

# 读未提交:

(1)打开一个客户端A,并设置当前事务模式为read uncommitted(未提交读),查询表account的初始值:

set tx_isolation='read-uncommitted';

(2)在客户端A的事务提交之前,打开另一个客户端B,更新表account:

(3)这时,虽然客户端B的事务还没提交,但是客户端A就可以查询到B已经更新的数据:

(4)一旦客户端B的事务因为某种原因回滚,所有的操作都将会被撤销,那客户端A查询到的数据其实就是脏数据:

(5)在客户端A执行更新语句**update account set balance = balance - 50 where id =1**,lilei的balance没有变成350,居然是400,是不是很奇怪,数据不一致啊,如果你这么想就太天真 了,在应用程序中,我们会用400-50=350,并不知道其他会话回滚了,要想解决这个问题可以采用读已提交的隔离级别

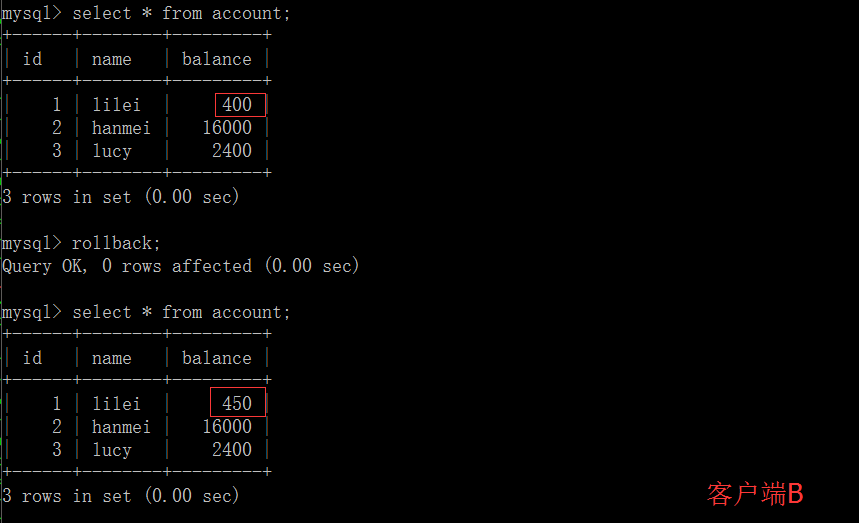

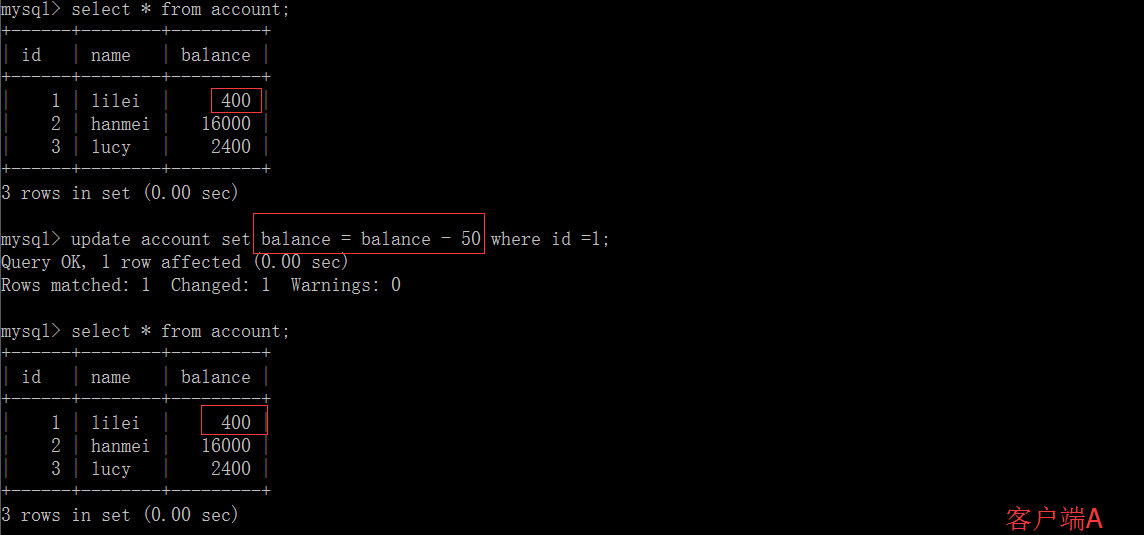

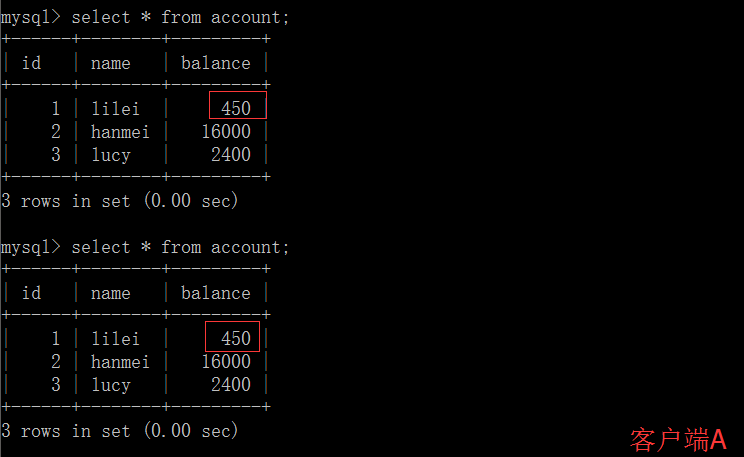

# 读已提交

(1)打开一个客户端A,并设置当前事务模式为read committed(未提交读),查询表account的所有记录:

set tx_isolation='read-committed';

(2)在客户端A的事务提交之前,打开另一个客户端B,更新表account:

(3)这时,客户端B的事务还没提交,客户端A不能查询到B已经更新的数据,解决了脏读问题:

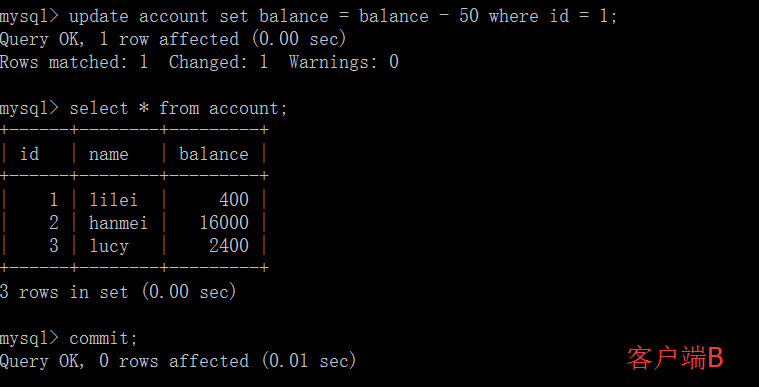

(4)客户端B的事务提交

(5)客户端A执行与上一步相同的查询,结果 与上一步不一致,即产生了不可重复读的问题

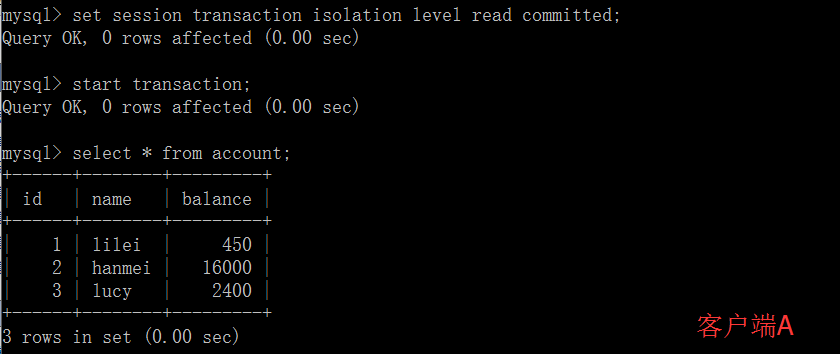

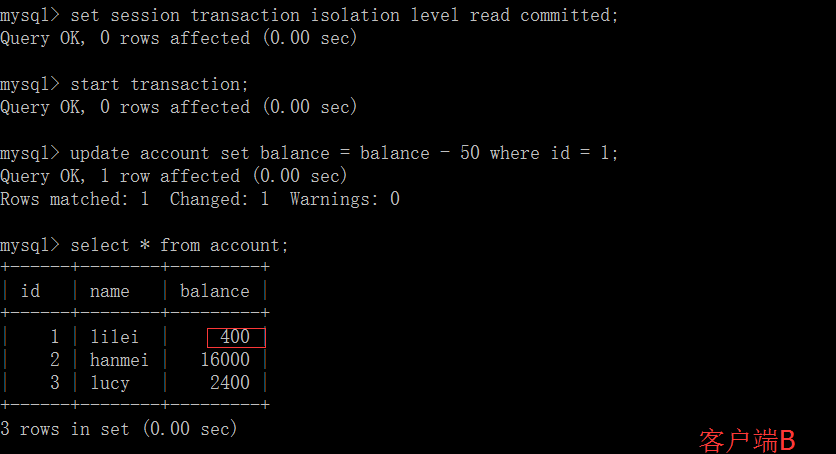

# 可重复读

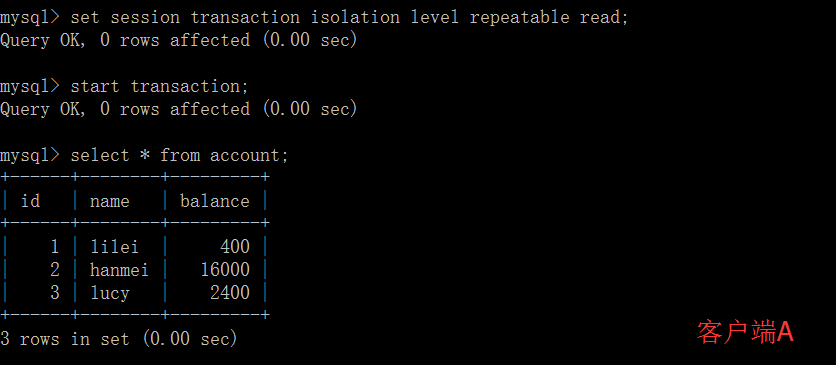

(1)打开一个客户端A,并设置当前事务模式为repeatable read,查询表account的所有记录

set tx_isolation='repeatable-read';

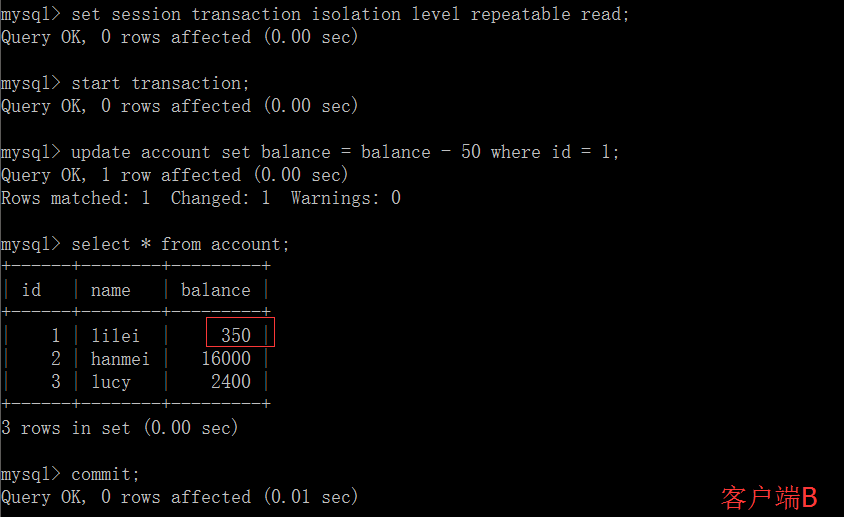

(2)在客户端A的事务提交之前,打开另一个客户端B,更新表account并提交

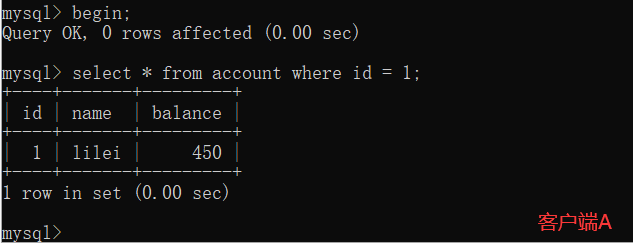

(3)在客户端A查询表account的所有记录,与步骤(1)查询结果一致,没有出现不可重复读的问题

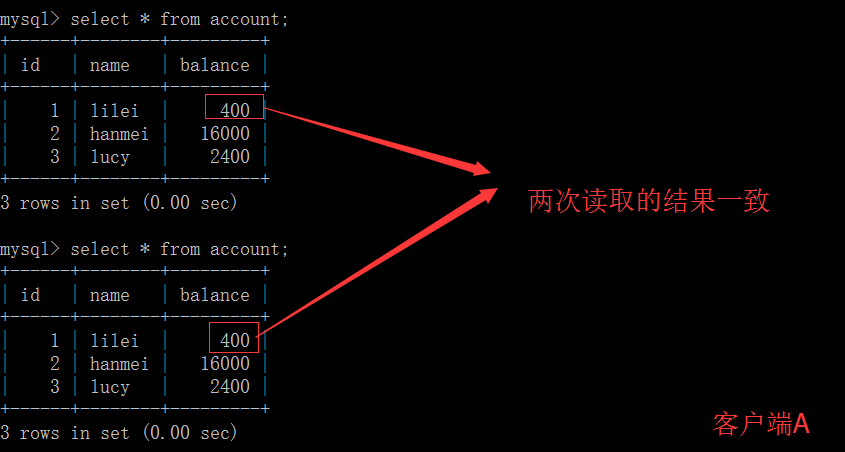

(4)在客户端A,接着执行update account set balance = balance - 50 where id = 1,balance没有变成400-50=350,lilei的balance值用的是步骤2中的350来算的, 所以是300,数据的一致性倒是没有被破坏。可重复读的隔离级别下使用了MVCC(multi-version concurrency control)机制,select操作不会更新版本号,是快照读 (历史版本);insert、 update和delete会更新版本号,是当前读(当前版本)。

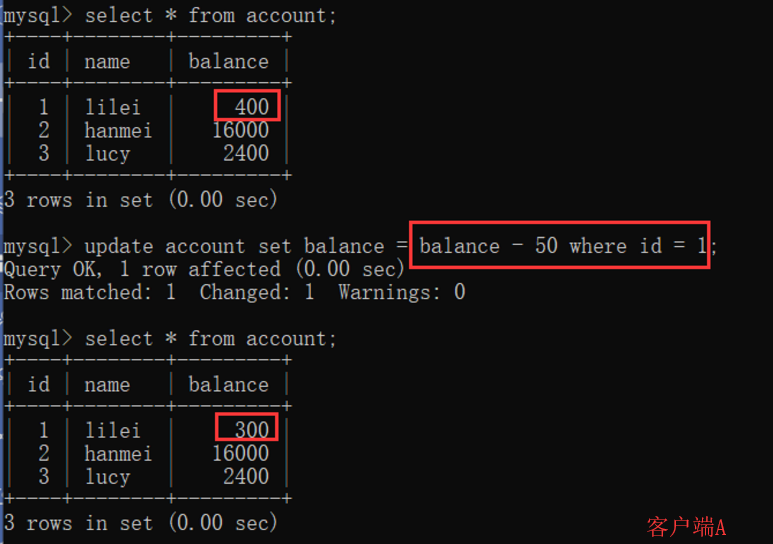

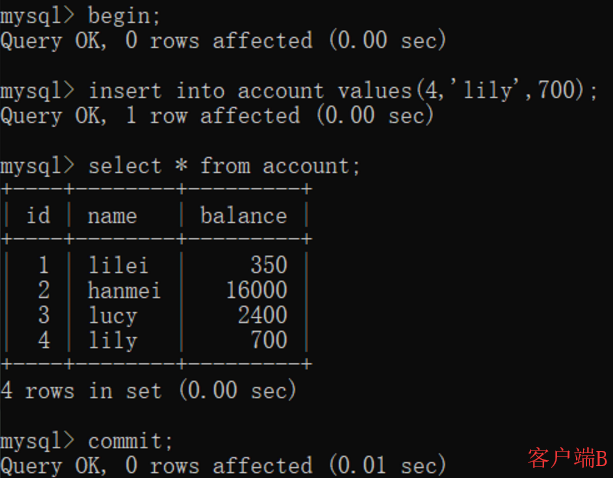

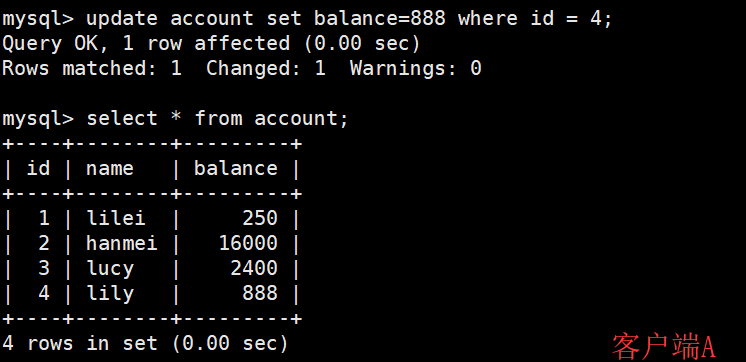

(5)重新打开客户端B,插入一条新数据后提交

(6)在客户端A查询表account的所有记录,没有查出新增数据,所以没有出现幻读

(7)验证幻读

在客户端A执行update account set balance=888 where id = 4;能更新成功,再次查询能查到客户端B新增的数据

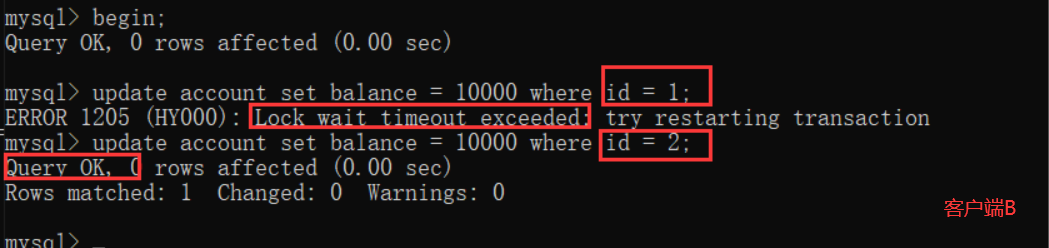

# 串行化

(1)打开一个客户端A,并设置当前事务模式为serializable,查询表account的初始值:set tx_isolation='serializable';

(2)打开一个客户端B,并设置当前事务模式为serializable,更新相同的id为1的记录会被阻塞等待,更新id为2的记录可以成功,说明在串行模式下innodb的查询也会 被加上行锁。

如果客户端A执行的是一个范围查询,那么该范围内的所有行包括每行记录所在的间隙区间范围(就算该行数据还未被插入也会加锁,这种是间隙锁)都会被加锁。此时如果客户端B在该范围内插入数据都会被阻塞,所以就避免了幻读。

这种隔离级别并发性极低,开发中很少会用到。